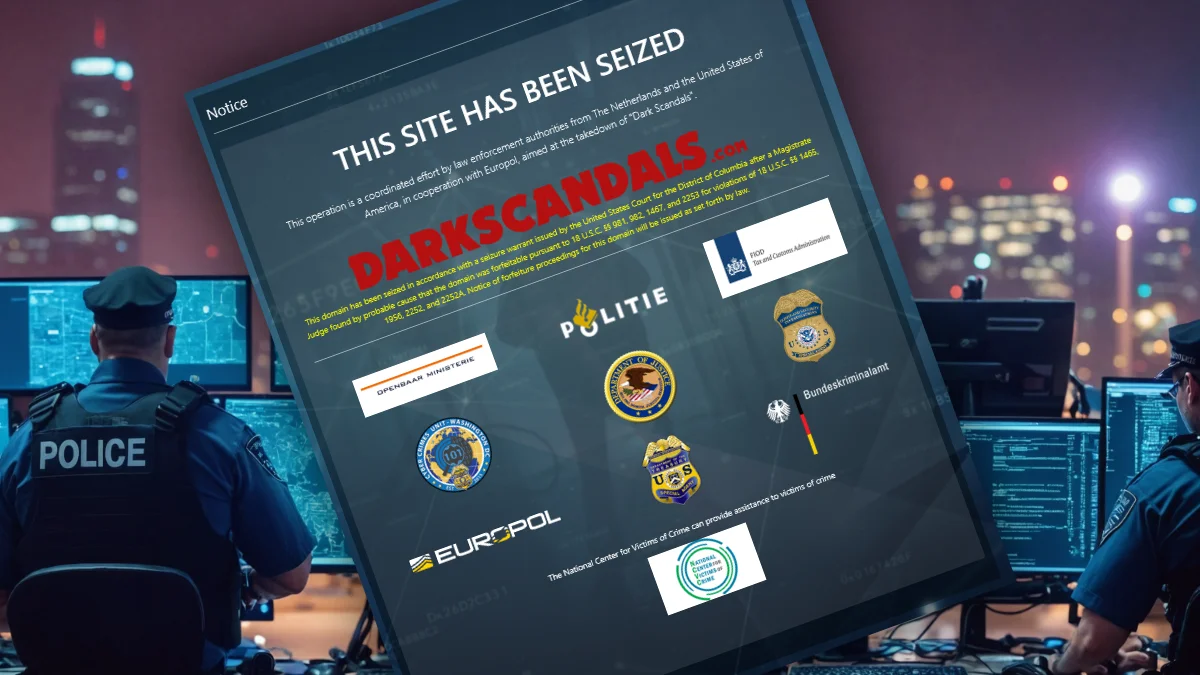

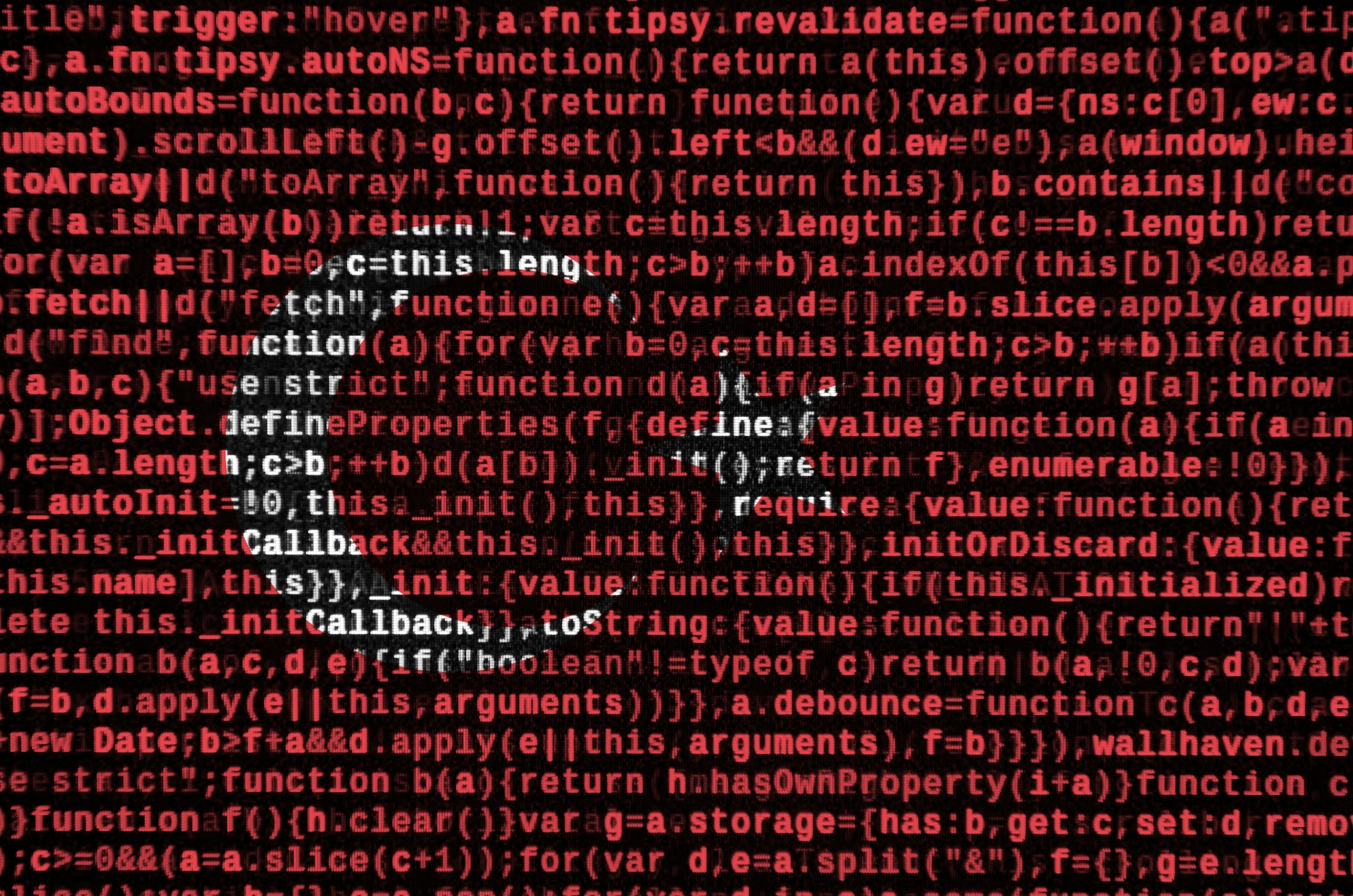

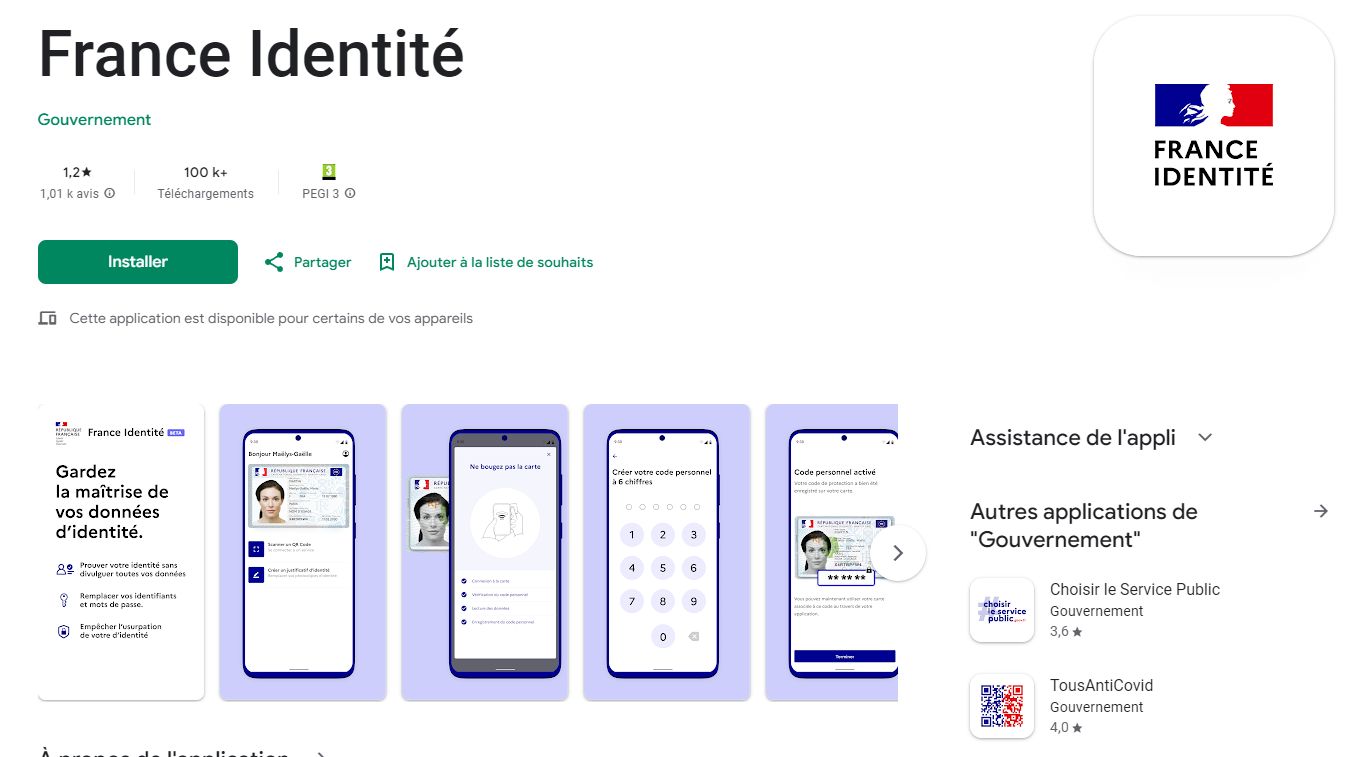

Protégez-vous des

cyber-escroqueries

et informez-vous avec France Verif

France Verif : Votre bouclier contre les cyber-escroqueries.

Informez-vous et défendez-vous efficacement contre les cyber-escroqueries. Naviguez dans le monde numérique en toute sécurité grâce à des conseils experts, des alertes à jour et des analyses approfondies. Notre plateforme s’engage à combattre la désinformation et les fraudes en ligne, vous offrant les outils et l’information nécessaires pour protéger vos données et votre vie numérique. Restez un pas devant les escrocs, informé et sécurisé.